医師になりすましたAI動画が67万人を欺いた——1週間で150万回再生の衝撃

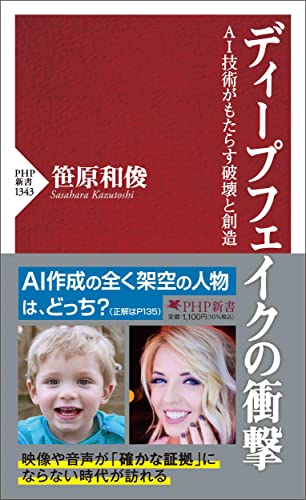

「心臓発作が一人のときに来たら、この10秒を知らないと死にます」。このタイトルの動画が、2026年3月にYouTubeで爆発的に広まった。語りかけるのは韓国国軍大田病院の院長であるイ・グク・ジョン教授——のように見える人物だ。実際には、AI技術で顔・声・話し方を完全に模倣した偽物だった。

チャンネル「イ・グク・ジョン教授の助言」は2026年3月20日に開設され、わずか1週間で登録者4万人を超え、6本の動画の累計再生数が150万回を突破した。問題の心臓発作動画だけで67万回以上の再生と3万5000件の高評価を獲得した。コメント欄には「一人暮らしのお年寄りに貴重な情報をありがとうございます」「イ教授がYouTubeをされているとは知りませんでした」という感謝の声が2000件以上寄せられた——視聴者の大多数が本物と信じていたのだ。

元記事・原文引用

元ネタ:「이 10초 모르면 죽는다」…67만명 홀린 ‘이국종 교수의 조언’(この10秒を知らないと死ぬ——67万人を欺いた「イ・グク・ジョン教授の助言」)(Korea Herald / 2026年3月27日)

チャンネルは「正しい医学知識と現実的な健康管理方法を分かりやすく伝える」と説明しているが、動画が推奨する2秒間隔での強い咳・胸部叩打・合谷穴刺激は、医学的に検証されていない方法だ。

なぜAI医療ディープフェイクは人を欺くのか——権威・信頼・アルゴリズムの三重構造

今回の事件が示すのは、単なる「フェイク動画」の問題ではない。「医療権威」「AIの精度向上」「プラットフォームのアルゴリズム」という三つの要因が重なった構造的な脆弱性だ。

イ・グク・ジョン氏は韓国で「野戦外科医の英雄」として知られる著名人だ。2011年の延坪島砲撃事件での救命活動や、数々のドキュメンタリーへの出演で広く認知されている。医師という職業的権威と個人的な知名度を合わせ持つ人物の顔・声をAIで再現すれば、視聴者が疑いを持たないのは自然なことだった。

さらに問題なのは、YouTubeのアルゴリズムがこの動画を「有益な健康コンテンツ」として推奨し続けた点だ。高評価数・視聴継続率・コメント数がすべて高水準だったため、プラットフォームは内容の真偽を問わず積極的に配信した。現在のプラットフォームには、著名人のディープフェイクかどうかを事前に検知する仕組みが存在しない。チャンネルが閉鎖されたのは、イ・グク・ジョン氏本人が個人情報侵害として申告した後だった。

医療情報の領域でこの問題が特に深刻なのは、偽情報が直接的な身体的被害につながるからだ。心臓発作時には即座に119番に通報し、心肺蘇生を行うことが唯一の正しい対応だが、動画では「一人でできる応急処置」として医学的根拠のない方法が提示されていた。韓国公共放送のMBCの報道によれば、動画を信じた視聴者が誤った番号に電話するケースも確認されており、実害が生じている。

韓国メディアが「AI権威詐称」の深刻さを報じた背景

韓国では2024年のテレグラムを通じた性的ディープフェイク問題を経て、AI生成コンテンツへの警戒感が高まっていた。それにもかかわらず今回の事件が起きたことに、韓国メディアは強い衝撃を持って報じた。

Korea Heraldは「プラットフォームの審査なしに誰でも権威を偽装できる時代が来た」と指摘し、Mediawatchは「팩트체크(ファクトチェック)では追いつかない速度でフェイクが拡散する新段階に入った」と分析した。韓国のXでは「イ・グク・ジョン詐称」がトレンド入りし、「有名人なら誰でもターゲットになる」という恐怖と、「なぜYouTubeはもっと早く消さなかったのか」という批判が噴出した。

国防部は公式声明で「該当チャンネルを通じたすべての要求は詐称であり、一切応じないよう」警告を出した。韓国通信標準委員会への削除・ブロック申請も行われたが、申請から措置完了までの期間中にすでに数十万回の拡散が起きていた。

日本でも起きている医療権威ディープフェイク——プラットフォームへの問いを共有する

この問題は韓国だけの話ではない。日本でも2024年以降、著名医師や有名経営者のディープフェイクを使った投資詐欺広告がFacebookやYouTubeで多発しており、国民生活センターへの相談件数が急増している。

韓国の今回の事件と日本の事例が共有する本質的な問題は、「権威の偽装コストがほぼゼロになった」という点だ。かつてなりすましには、実物の映像・音声素材の編集技術と多大な労力が必要だった。今やスマートフォンとAIアプリがあれば、誰でも数分で著名人の「顔をした動画」を生成できる。

日本では2025年に改正プロバイダ責任制限法が成立し、ディープフェイク被害への法的対応が整備された。しかし法律が整備されても、アルゴリズムが偽情報を大量推奨する構造は変わっていない。韓国政府が6月の地方選挙を前に「フェイクニュース対策ゼロ・トレランス」を宣言し、専任捜査チームを設置したのも、法整備だけでは不十分だという認識があるからだろう。

医療権威を偽装できる時代に、視聴者は何を信じればよいか

「この著名医師の動画は本物か偽物か」を視聴者が自力で判断するのは、技術的にほぼ不可能になりつつある。ディープフェイク検知ツールも存在するが、一般の視聴者がそれを日常的に使うのは現実的ではない。

今回の事件が突きつける問いは二層構造だ。第一層は視聴者への問い——「その医療情報を信じる前に、チャンネルの開設日と認証マークを確認したか?」。第二層はプラットフォームへの問い——「著名人の顔・声を使ったコンテンツを事前に検知し、本人確認なしでは配信しない仕組みをなぜ作らないのか?」。後者こそが、今後の国際的な議論の中心になるだろう。AIが医師を演じられる時代に、信頼の保証者は誰なのか。

参照・原文リンク

- Korea Herald:67万人を欺いた「イ・グク・ジョン教授の助言」(2026年3月27日)

- 文化日報:「イ・グク・ジョン教授がYouTubeを?」68万人が騙された(2026年3月27日)

- OECD AI:韓国での医師ディープフェイクによる医療偽情報拡散(2026年3月26日)