📝 どんなニュース?

2026年1月22日、韓国が世界初の包括的なAI安全法「人工知能発展及び信頼基盤造成等に関する基本法」(通称:AI基本法)を正式施行した。「高リスクAI」と「生成型AI」という2つのカテゴリーを法的に定義し、企業に対してAI生成コンテンツへのウォーターマーク義務付け・現地代表者の選任などを求める内容だ。違反時の罰金は最大3000万ウォン(約330万円)で、施行から1年間は過料を猶予する計期間も設けられた。これは「AIを規制するルールとは何か」という問いに、世界で初めて国家レベルで包括的な答えを出した歴史的な瞬間だ。

📰 元記事・原文引用

元ネタ:Korea becomes 1st nation to enact comprehensive law on safe use of AI(The Korea Times / 2026年1月22日)

“Applying watermarks to AI-generated content is the minimum safeguard to prevent side effects from abuse of AI technology, such as deepfake content.”

🔥 なぜ今、話題になっているの?

AIをめぐる規制競争は、EU・中国・アメリカの三極が先行しているように見えた。ところが韓国がその先を行った──少なくとも「包括法の施行」という点において。

構造的に見ると、この法律が生まれた背景には三つのプレッシャーがある。①ディープフェイク被害の急増(2024〜2025年に韓国では著名人・一般人を問わず性的ディープフェイク被害が社会問題化した)、②AIスタートアップ支援と投資誘致(「規制の明確化」こそが企業が求めること)、そして③国際的なルール競争への参加(EUのAI法に次ぐ第二の包括法となることで、規制の”輸出国”になれる)だ。

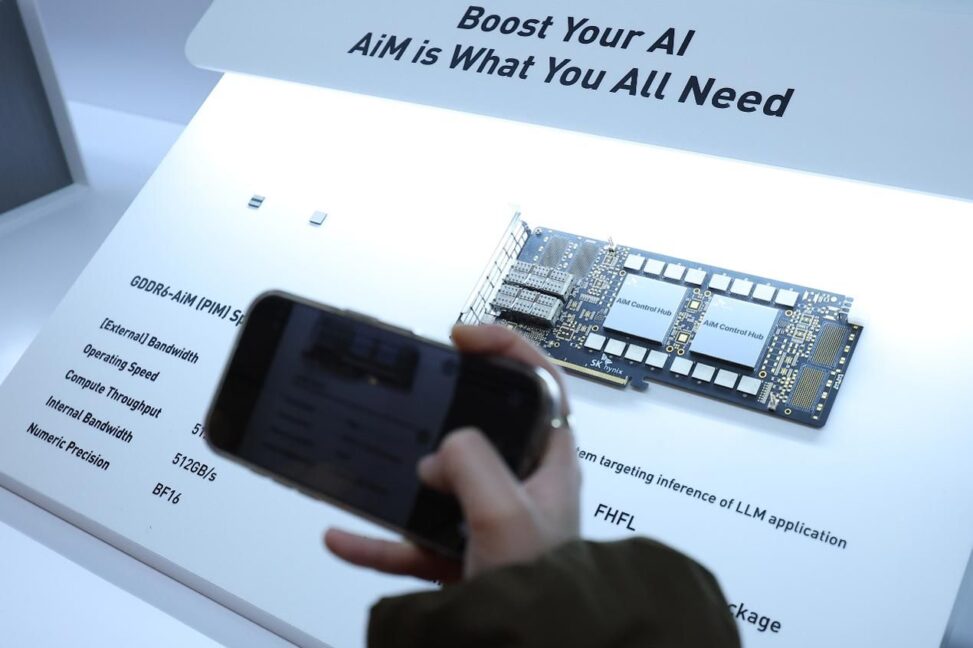

法律の肝は「高リスクAI」の定義にある。雇用の採用・不採用判定、ローン審査、医療診断など「人の重大な権利に影響を与えるAI」をこのカテゴリーに分類し、透明性確保・リスク管理・現地代表者の選任を義務化した。ChatGPTやGeminiのような「生成型AI」については、AI生成コンテンツに対するウォーターマーク(電子透かし)の義務付けが目玉だ。ディープフェイクのような視覚的に偽装されたコンテンツには「目に見えるウォーターマーク」、それ以外の生成コンテンツにはメタデータへの「見えないウォーターマーク」が求められる。

一方で、OpenAIやGoogleといったグローバル企業は施行前から「規制の柔軟性」を求めるロビー活動を展開していた。韓国政府も現実を意識し、1年間の計期間(この間は調査・過料なし)を設けた。つまり「法は動いているが、実際の執行は2027年以降」という構造になっている。これはEU AI法と同様の”段階的施行”方式であり、政策設計としては合理的だ。

🇯🇵 日本企業・日本社会への影響は?

日本はどう受け取るべきか。端的に言えば、「韓国モデル」は日本が参照すべき先行事例になった。

日本でも2023年のAI戦略会議以降、政府はAI規制の方向性を模索してきた。しかし2026年3月時点で日本は包括的なAI法を持っていない。「まず育てて、後で規制する」という産業政策的スタンスが続いている。韓国が「規制の枠組みを先に作る」戦略に転換したのと対照的だ。

実務的な影響として最も重要なのは、韓国市場でサービスを提供する日本企業への直撃だ。採用選考・与信判断・医療支援などにAIを使っている日本企業が韓国展開している場合、「高リスクAI」と判定されれば現地代表者の選任と詳細なリスク管理文書の提出が求められる。ChatGPTのように生成AIを使ったチャットボットやコンテンツ生成サービスを韓国向けに提供する場合も、ウォーターマーク実装が必要になる。

より長期的には、「韓国が法律を作る → 国際標準に影響する → 日本も無視できなくなる」というパスが現実になりうる。EUのAI法が「ブリュッセル効果」(EU規制が世界のデファクトスタンダードになる現象)をもたらしたように、韓国のAI基本法も「ソウル効果」を起こす可能性がある。日本のAI政策立案者にとって、今は韓国の法執行の詳細を注視する時だ。

まとめ

韓国のAI基本法施行は、単なる国内法の話ではない。「世界初」の包括法として、今後のグローバルなAI規制議論の基準点になりうる。高リスクAIの定義・ウォーターマーク義務・段階的執行という三つの設計は、日本を含む各国が参照するモデルケースとなった。1年間の計期間が終わる2027年初頭、韓国がどこまで実際に法律を”使う”かを見届けることが、AI規制の次の焦点になるだろう。